Eerste stap van de AI Act. Binnenkort allemaal AI geletterd?

De AI Act reguleert de ontwikkeling en het gebruik van AI binnen de Europese Unie, en geldt ook voor buitenlandse bedrijven die hun producten aan Europeanen aanbieden. De wet heeft een tweeledig doel: enerzijds het bevorderen van veilige en betrouwbare AI-systemen die de fundamentele rechten van EU-burgers respecteren, anderzijds het stimuleren van AI-investeringen en innovatie in Europa. De sancties bij overtreding zijn aanzienlijk: tot 35 miljoen euro of 7% van de jaarlijkse bedrijfsomzet. De AI Act, die op 1 augustus 2024 in werking trad, wordt stapsgewijs ingevoerd. Sinds 2 februari zijn AI-systemen met onacceptabel risico verboden en gelden er verplichtingen rond AI-geletterdheid.

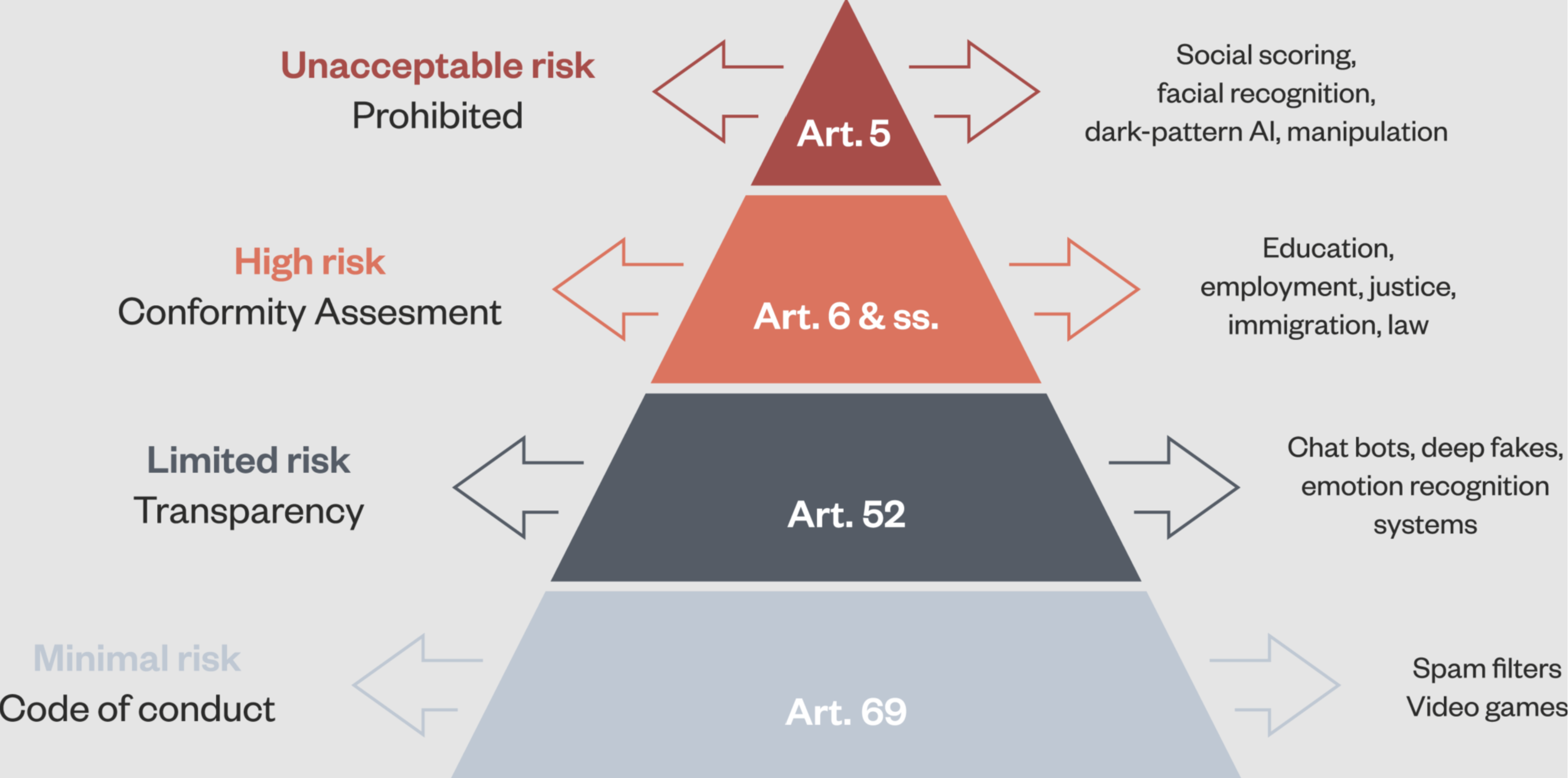

De basis van de wet is een indeling van AI-toepassingen in risicoklassen (zie figuur): van onacceptabel (en dus verboden) tot minimaal risico. Systemen in de categorie ‘hoog risico’ moeten voldoen aan strikte verplichtingen, waaronder risicobeoordeling en mitigatie strategieën.

De risicoklassen in de AI Act zijn niet scherp afgebakend, waardoor er onduidelijkheid bestaat over de classificatie van veel systemen. Om dit te verduidelijken publiceerde de Europese Commissie op 4 februari, twee dagen na de start van het verbod op systemen in de hoogste risicoklasse, een document met richtlijnen. Deze niet-bindende richtlijnen bevatten praktische voorbeelden en toelichtingen voor de interpretatie en naleving van de AI Act. Zo zijn sociale scoringsalgoritmes in het algemeen verboden, maar mogen financiële instellingen wel AI gebruiken om de kredietwaardigheid van klanten te beoordelen. Op 6 februari volgde nog een aanvullende richtlijn over de definitie van AI en wat er binnen de AI Act onder een AI-systeem valt. Deze tekst stelt vast dat er geen sluitende classificatie of volledige lijst kan worden opgesteld van systemen die wel of niet onder de definitie vallen.

De systemen in de hoogste risicoklasse zijn sinds 2 februari in principe verboden, maar de handhaving en sancties van de AI Act treden pas in werking vanaf 2 augustus 2025. Tot die datum blijft het verbod dus zonder actieve handhaving. Er heerst nog veel onduidelijkheid over de implementatie van deze handhaving. Lidstaten moesten voor 2 november 2024 hun nationale bevoegde instanties aanwijzen. Op die deadline hadden slechts 7 van de 27 lidstaten dit gedaan, en op het moment dat deze post verschijnt zijn er nog steeds 6 lidstaten die in gebreke blijven, waaronder, je raadt het al, België.

De AI Act wordt wereldwijd gezien als een van de meest vooruitstrevende AI-wetgevingen, maar de totstandkoming verliep moeizaam. Het proces begon in april 2021 met een eerste voorstel van de Europese Commissie en duurde tot eind 2023 voordat de finale tekst werd goedgekeurd. Een belangrijke complicerende factor was de introductie van ChatGPT tijdens het wetgevingsproces. Deze ontwikkeling leidde ertoe dat plotseling veel meer mensen AI gingen gebruiken. De snelle evolutie van de onderliggende taalmodellen, die steeds krachtiger werden, bracht nieuwe risico’s met zich mee die niet in het originele voorstel waren meegenomen. Deze systemen werden uiteindelijk in 2023 in de wetgeving opgenomen onder de bredere term ‘general-purpose AI’ (GPAI) modellen.

De ontwikkeling van deze GPAI-modellen vereist enorme investeringen. Dit leidde bij de introductie in de AI Act tot intensieve lobbyactiviteiten vanuit de industrie. Het Byte to Byte rapport van Corporate Europe Observatory toont aan dat grote technologiebedrijven buitenproportioneel veel toegang hadden tot Europese beleidsmakers in vergelijking met andere belanghebbenden (zie ook figuur). Een sprekend voorbeeld: Google’s CEO Sundar Pichai wist op één dag gesprekken te voeren met drie verschillende Europese commissarissen.

Het lobbywerk tegen de AI Act was succesvol en zwakte de wetgeving aanzienlijk af, maar het was uiteindelijk de weerstand vanuit Europa zelf die de doorslag gaf. De Franse startup Mistral AI en de Duitse startup Aleph Alpha vonden gehoor bij hun respectievelijke regeringen. Een Frans-Duits-Italiaans front zorgde er vervolgens voor dat bindende maatregelen uit de AI Act verdwenen en werden vervangen door transparantievereisten. De strengste regels gelden voor GPAI-systemen met een systemisch risico. De enige concrete definitie hiervoor betreft modellen waarvoor bij de ontwikkeling meer dan 10^24 FLOPS aan computerberekeningen nodig waren, een enorme hoeveelheid waar momenteel wereldwijd alleen GPT-4 van OpenAI onder valt. Deze grens lijkt al helemaal achterhaald sinds het Chinese Deepseek aantoonde dat er veel minder computerkracht nodig is voor deze modellen. Hoewel modellen met grote maatschappelijke impact ook onder deze categorie met systemisch risico vallen, blijft vooralsnog onduidelijk hoe dit precies wordt bepaald.

Tijdens de AI Action top in Parijs eerder deze week leken sommige Europese leiders gemengde gevoelens te hebben over de AI Act. De Franse president Macron benadrukte het belang van innovatie en waarschuwde dat regulering deze kan belemmeren. Hij verklaarde dat Europa nog steeds meedoet in de ‘AI race’ en kondigde Franse investeringen aan ter waarde van 109 miljard euro. Ursula Von der Leyen, de voorzitter van de Europese Commissie, bevestigde dat de AI race nog niet voorbij is en lanceerde InvestAI, een publiek-private samenwerking ter waarde van 200 miljard euro. De Amerikaanse vicepresident JD Vance verzette zich nadrukkelijk tegen regulering en stelde dat de Europese wetgeving de technologie ‘wurgt’. De slotverklaring van de top in Parijs over ‘inclusieve en duurzame AI’ werd niet ondertekend door de VS en het VK, waardoor de top algemeen als een gemiste kans wordt beschouwd.

Op 2 februari trad ook het artikel over AI-geletterdheid in de AI Act in werking. De originele versie was hier een stuk ambitieuzer: deze verplichtte zowel lidstaten als bedrijven om AI-geletterdheid in alle sectoren van de samenleving te bevorderen. In het finale artikel zijn de lidstaten echter geschrapt en richt de wet zich alleen op AI-bedrijven. Zij moeten ervoor zorgen dat hun personeel en andere betrokkenen een ‘voldoende niveau’ van AI-geletterdheid bereiken. Dit niveau hangt af van de context, zoals de risicoklasse van het AI-systeem, maar wat precies als ‘voldoende’ wordt beschouwd en hoe dit zal worden gehandhaafd, blijft voorlopig onduidelijk.

De definitie van AI-geletterdheid in de AI Act reikt verder dan alleen bedrijven en deze vermeld dat ook personen die door AI-systemen worden beïnvloed, moeten beschikken over AI-geletterdheid. In de definitie wordt bij AI geletterdheid onder andere verstaan dat men bewust is van de mogelijkheden, risico’s en potentiële schade van AI. Dit stuk gaat veel breder dan enkel de werknemers van AI bedrijven. Een aanvullende bepaling (Recital 20) benadrukt het belang van een brede implementatie van AI-geletterdheid en de rol van de Europese AI Raad hierin. We kunnen dus verwachten dat Europa nog meer initiatieven zal lanceren rond AI-geletterdheid. De Vlaamse AI Academy (VAIA) voorziet alvast enkele tips om te werken aan AI geletterdheid.

De AI Act is vooruitstrevend en behandelt belangrijke maatschappelijke uitdagingen van AI (hoewel bijvoorbeeld de ecologische voetafdruk buiten beschouwing blijft). De implementatie blijkt echter complex. De wet beoogt innovatie te stimuleren, maar de industrie toonde zich hierover sceptisch. Door krachtige tegenstand is de wetgeving significant afgezwakt. Er zijn nog diverse obstakels te overwinnen, waarbij veel zal afhangen van de uiteindelijke interpretatie en handhaving, aspecten die momenteel nog onduidelijk zijn.

Vond je deze post interessant?

Dan zijn deze misschien ook iets voor jou! 👇